LLM-03 大模型 15分钟 FineTuning 微调 GPT2 模型 finetuning GPT微调实战 仅需6GB显存 单卡微调 数据 10MB数据集微调

参考资料 GPT2 FineTuning OpenAI-GPT2 Kaggle short-jokes 数据集 Why will you need fine-tuning an LLM? LLMs are generally trained on public data with no specific focus. Fine-tuning is a cr...

AIGC使用问题之GPT-3的数据集是如何构建的

问题一:GPT-2中的zero-shot设定是什么意思?prompt(提示)又是什么? GPT-2中的zero-shot设定是什么意思?prompt(提示)又是什么? 参考回答: zero-shot设定意味着在做下游任务时,不需要下游任务的任何标注信息,也不需要训练模型。只需要一个预训练好的大模型来直接预测子任务的结果。 在GPT-2中,pro...

想用 ModelScope的openai在线微调gpt-4v,怎么用图片做数据集?

想用 ModelScope的openai在线微调gpt-4v,怎么用图片做数据集?

KDD 2023 | GPT时代医学AI新赛道:16万张图片、70万问答对的临床问答数据集MIMIC-Diff-VQA发布

大模型想打开应用前景,要从数据集入手。胸部 X 光片图像作为临床诊断最常用的手段之一,是计算机与医学结合的一个重要领域。其丰富的视觉和病例报告文本信息促进了 vision-language 在医学领域发展。医学 VQA 是其中的一个重要方向,近年来比较著名的 ImageCLEF-VQA-Med,和 VQA-RAD 数据集包含了许多了胸部 X 光片问答对。然而,尽管 X 胸片检查报告中包含大量临床....

终极「揭秘」:GPT-4模型架构、训练成本、数据集信息都被扒出来了

一直以来,大家都对 GPT-4 的模型架构、基础设施、训练数据集、成本等信息非常好奇。奈何 OpenAI 嘴太严,很长时间以来,大家也都只是猜测这些数据。不久之前,「天才黑客」乔治・霍兹(George Hotz)在接受一家名为 Latent Space 的 AI 技术播客采访时透露出一个小道消息,称 GPT-4 是由 8 个混合专家模型组成的集成系统,每个专家模型都有 2200 亿个参数(比 G....

爆火的「GPT-4 MIT本科数学满分」论文作弊,数据集本身有问题

爆火的「GPT-4 MIT本科数学满分」论文作弊,数据集本身有问题机器之心 2023-06-18 13:12 发表于北京机器之心报道编辑:蛋酱结论不应该如此被夸大。这两天,一篇关于 GPT-4 满分通过 MIT EECS 和数学本科考试的论文在推特上疯传。论文地址:https://arxiv.org/pdf/2306.08997.pdf简单概括,一个来自 MIT 的研究团队从自己学校的数学、电气....

7 Papers | 浙大研究获SIGMOD 2023最佳论文;GPT-4拿下最难数学推理数据集新SOTA

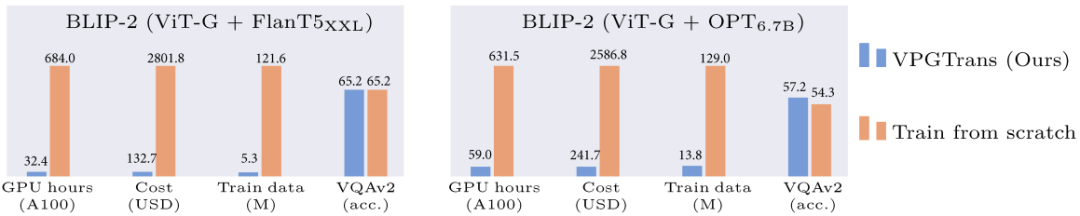

本周论文包括 10% 成本定制专属类 GPT-4 多模态大模型;GPT-4 拿下最难数学推理数据集新 SOTA 等研究。目录:Transfer Visual Prompt Generator across LLMs Progressive-Hint Prompting Improves Reasoning in Large Language ModelsAutoML-GPT: Automatic....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。